Avec les données d’indexation, les statistiques d’exploration de votre site web par Googlebot sont essentielles pour avoir une vision d’ensemble de l’état de santé de votre SEO.

Bien sûr, Google met à disposition des webmasters sa fameuse Search Console, un outil extrêmement utile à défaut d’être exhaustif. Car de nombreuses données semblent filtrées, sinon fragmentaires, un fait que Google n’a jamais nié – allant même jusqu’à prévenir les webmasters du caractère partiel de son rapport sur les backlinks externes.

C’est pourquoi je propose aujourd’hui un tutoriel relativement simple qui vous permettra à la fin d’obtenir un rapport détaillé des allées et venues de Googlebot sur votre site.

3, 2, 1, c’est parti !

Les prérequis

- Un serveur sous cPanel / WHM pour produire le log (à défaut, un serveur sous Apache)

- Microsoft Excel

- 7-zip ou tout autre logiciel de compression

Ma configuration personnelle

- Serveur sous CentOS 7.6 et opérant avec WHM v76.0.18

Etape 1: récupérer les access logs

Dans cette partie je vais couvrir surtout les utilisateurs de cPanel/WHM. Si vous n’utilisez pas ce software mais que votre serveur tourne sur Apache quand même, je vous invite à vous renseigner sur la marche à suivre. Une fois les logs en votre possession, procédez à l’étape 2.

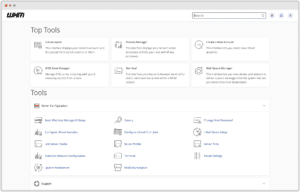

Connectez vous à cPanel

Connectez vous au compte cPanel correspondant au site dont vous souhaitez analyser les logs. Une fois connecté, scrollez vers le bas jusqu’à apercevoir la partie « Mesures ».

Entrez dans Accès brut

Une fois à l’intérieur, vous avez ici le choix :

- vous pouvez télécharger les Journaux d’accès bruts actuels, qui contiennent les entrées les plus récentes.

- ou vous pouvez télécharger les Journaux bruts archivés, qui contiennent l’intégralité des données de chaque mois, y compris celui en cours.

Pour ce tutoriel je vais télécharger les Journaux archivés.

Si votre site utilise le protocole HTTPS, téléchargez le fichier nomdedomaine-ssl_log-mois–année.gz

Dans mon cas, le fichier est intitulé contentincontext.org-ssl_log-Jan-2019.gz

Si mon site n’utilisait pas le protocole HTTPS, j’aurais téléchargé contentincontext.org-Jan-2019.gz

Vous avez maintenant à votre disposition une archive .gz content les access logs de votre site web. Procédons à la suite !

Etape 2 : décompressez (l’archive)

Créez un dossier placeholder sur votre bureau, et déplacez l’archive à l’intérieur.

Par un simple clic droit, vous aurez accès au menu contextuel de 7-zip. Survolez donc 7-zip, et cliquez simplement sur Extraire ici.

Etape 3 : mettre en forme les logs sous Excel

Ouvez Microsoft Excel, et faîtes glisser le fichier obtenu après décompression dans la fenêtre du logiciel.

Et là, c’est le drame.

Ou plutôt le bordel. Pas de panique, on va mettre tout ça en forme.

Dans le menu principal, cliquez sur l’onglet Données.

Ensuite, cliquez sur la première colonne de votre tableur, donc dans la majorité des cas, la colonne A. Assurez-vous qu’elle soit intégralement sélectionnée, puis de retour dans le menu, cherchez le bouton Convertir. Sélectionnez l’option Délimité, puis dans la fenêtre suivante, décochez Tabulation et cochez Espace. La fenêtre suivante n’a pas à être modifiée, vous pouvez donc Terminer.

Tadaaaa ! Plutôt que toutes les informations soient contenues dans une seule colonne, nous avons fais en sorte de les séparer. Un oeil avisé pourra ainsi discerner les colonnes correspondantes aux adresses IPs, aux heures de connexion, aux user agents, etc etc etc !

Etape 4 : extraire Googlebot

Car oui, notre ami robot est naturellement noyé dans un océan de données. Mais pour le trouver, c’est bien simple, on va filtrer !

Cliquez sur la colonne contenant les User-Agents (la dernière, comme vous pouvez le deviner). Assurez vous, à nouveau, qu’elle soit intégralement sélectionnée.

De là, cliquez sur l’option « Filtrer » du menu Données (que vous ne devriez pas avoir quitté depuis la dernière fois). Cela devrait faire apparaître une petite flèche comme dans le screenshot ci-dessous :

Cliquez donc sur la flèche, puis dans les Filtres textuels, cherchez la mention « Contient… »

Et là, si vous avez bien suivi, on renseigne tout simplement « Googlebot. » On confirme, et magie : vous avez sous les yeux l’intégralité des visites de Googlebot sur votre site. Vous ne trouverez pas de source plus exhaustive pour cette data, car vous êtes allés la chercher à la source, dans les entrailles de votre webserver.

Avec un léger travail de mise en forme on peut arriver à ce résultat là. Les datas apparaissent ici clairement, et il serait aisé pour moi d’en tirer ce qui m’intéresse comme mes pages qui sont les plus visitées par Google, ou au contraire, celles qui le sont le moins. De même, il est possible de voir les codes de statut de chaque URL : pratique pour déceler des erreurs 400 ou des redirections 301.

Pour conclure

Il doit sûrement exister des logiciels ou sites web qui facilitent l’obtention de ces informations. Mais j’ai ce vilain défaut qui est de ne pas vouloir installer des software pour des tâches que je peux effectuer moi-même en peu de temps. Donc si vous êtes comme moi et que ce tuto vous a été d’une aide (relative ou grande), n’hésitez pas à le partager !

Be the first to comment on "Googlebot: obtenir ses statistiques d’exploration complètes via les access logs Apache"